Billions Lost, Millions Exposed: The AI Fails That Defined 2025

Introduction

L’année 2025 marque un tournant dans l’histoire du développement de l’intelligence artificielle (IA). Alors que cette technologie est souvent perçue comme le vecteur d’avancées extraordinaires, elle a également révélé des défaillances notables, entraînant des pertes financières considérables et mettant en lumière des vulnérabilités inquiétantes. Cet article se penche sur les principales échecs de l’IA survenus cette année-là, en analysant leurs conséquences tant sur le plan économique que social.

Des pertes financières astronomiques

Les défaillances des systèmes de prévision

Au cours de l’année 2025, de nombreuses entreprises ont investi massivement dans des outils d’IA pour améliorer leurs systèmes de prévision, notamment dans le secteur financier et logistique. Cependant, plusieurs algorithmes se sont révélés faillibles, entraînant des pertes dépassant les 10 milliards d’euros. Des entreprises emblématiques, telles que plusieurs banques d’investissement, n’ont pas réussi à anticiper les fluctuations du marché, provoquant des cris d’alarme parmi les investisseurs.

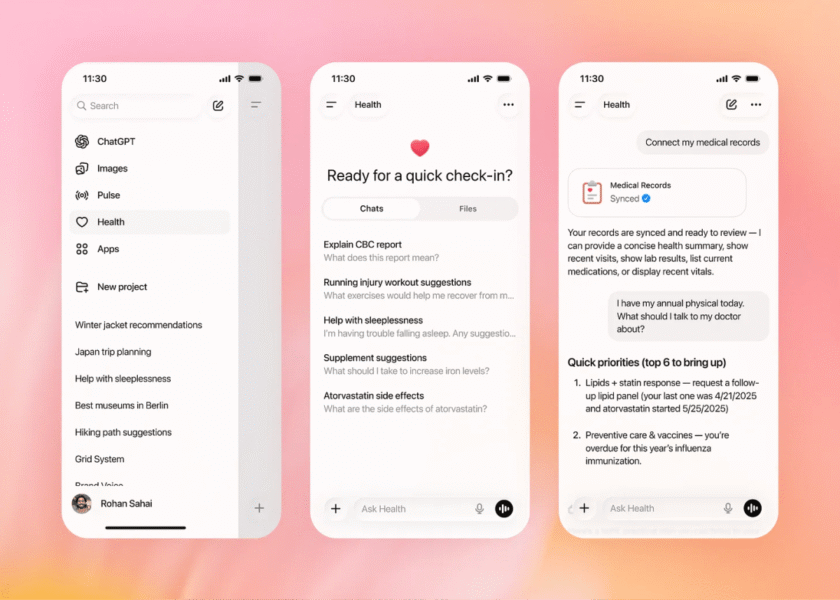

La faille des systèmes de sécurité et de protection des données

Un autre domaine où l’IA a échoué de manière spectaculaire est celui de la sécurité des données. De grandes entreprises technologiques, ayant mis en place des systèmes de protection basés sur l’IA, ont subi des violations de données massives. En mars 2025, une attaque ciblée a exposé les informations personnelles de millions d’utilisateurs, entraînant non seulement des coûts de réparation et de dédommagement s’élevant à plusieurs milliards, mais aussi une dégradation de la confiance du public envers ces technologies.

Exposition de millions d’individus

Les répercussions sur la vie privée

Les échecs des systèmes d’IA n’ont pas seulement conduit à des pertes financières, mais ont également eu des conséquences catastrophiques pour la vie privée des citoyens. Environ 30 millions de personnes se sont retrouvées vulnérables à des violations de leurs données personnelles. Ces incidents ont soulevé des questions pertinentes sur l’éthique de l’utilisation de l’IA, ainsi que sur la responsabilité des entreprises face à la protection des données de leurs utilisateurs.

Les biais algorithmiques et leur impact social

Les biais algorithmiques, bien qu’ils soient connus depuis des années, ont atteint un niveau de gravité inacceptable en 2025. Des systèmes de recrutement basés sur l’IA ont discrédité des milliers de candidatures en raison de préjugés intégrés dans les algorithmes. Cela a suscité de vives réactions de la part des organisations de défense des droits humains, qui dénoncent la discrimination systémique à laquelle sont confrontées certaines populations, notamment des minorités ethniques et des groupes de sexes différents.

Vers une réglementation renforcée

Les initiatives législatives

Face à ces défaillances évidentes, les gouvernements dans le monde entier ont commencé à prendre des mesures pour réguler l’utilisation de l’IA. Des propositions législatives visant à instaurer des normes de transparence et de responsabilité sont apparues, incitant les développeurs à incorporer des protocoles de vérification rigoureux dans leurs systèmes. L’exigence d’audits réguliers des algorithmes est devenue une nécessité pour éviter de futurs échecs.

Les initiatives au sein des entreprises

Des entreprises ont également entrepris de revoir leurs pratiques internes en matière d’IA. De nombreuses sociétés ont créé des comités d’éthique pour évaluer et superviser le développement de leurs systèmes d’IA. Ces efforts visent à garantir que l’innovation ne se fasse pas au détriment de la sécurité des utilisateurs et de l’intégrité des données.

Conclusion

L’année 2025 a été marquée par des échecs significatifs dans le développement de l’intelligence artificielle, entraînant des milliards d’euros de pertes et exposant des millions de citoyens à des risques inacceptables. Ces événements ont suscité une prise de conscience généralisée des conséquences potentiellement dévastatrices des technologies mal régulées. En réponse, les gouvernements et les entreprises commencent à agir, avec l’espoir que des réglementations adéquates et des initiatives éthiques permettront de prévenir de tels incidents à l’avenir. L’enjeu est désormais de tirer les leçons de ces échecs afin de bâtir un avenir où l’IA soit synonyme de progrès, de sécurité et de respect des droits individuels.