Introduction

Selon une récente enquête menée par BairesDev, seulement 9 % des développeurs estiment que le code généré par l’intelligence artificielle (IA) peut être utilisé sans supervision humaine. Cette statistique soulève des questions cruciales sur la place de l’IA dans le développement logiciel et met en lumière les préoccupations persistantes concernant la fiabilité et la sécurité du code généré par des algorithmes. Cet article se penchera sur les résultats de cette enquête, les raisons qui poussent les développeurs à privilégier la supervision humaine et les implications pour l’avenir de la pratique du développement logiciel.

Contexte de l’enquête

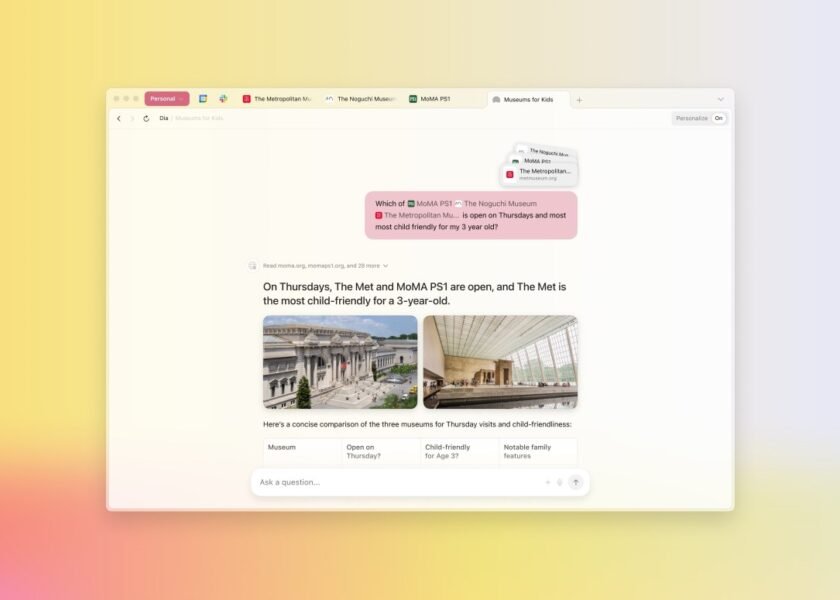

La montée en puissance de l’intelligence artificielle dans le domaine du développement logiciel est indéniable. Plusieurs outils et plateformes, tels que GitHub Copilot et Codex d’OpenAI, promettent d’améliorer l’efficacité et de réduire le temps consacré à la programmation. Toutefois, l’enquête de BairesDev met en évidence une certaine méfiance parmi les développeurs. En parallèle, la question de l’intégration de l’IA dans des environnements de travail existants constitue un défi majeur, tant sur le plan technique qu’éthique.

Un besoin de supervision humaine

Le faible pourcentage de développeurs qui se disent favorables à un usage du code IA sans supervision met en lumière une préoccupation centrale : la possibilité d’erreurs. Les algorithmes de machine learning, bien qu’évolués, ne sont pas exempts de défauts. En effet, la qualité du code généré dépend souvent des données sur lesquelles ils ont été entraînés. Une mauvaise entrée peut donc mener à des résultats imprévisibles, voire dangereux.

La question de la qualité du code

L’enquête a révélé que près de 72 % des développeurs considèrent que la qualité du code généré par l’IA requiert une validation humaine. Les développeurs tiennent à s’assurer que le code est non seulement fonctionnel, mais également maintenable et compréhensible par d’autres membres de l’équipe. En outre, les erreurs de logique ou les failles de sécurité peuvent avoir des conséquences graves, rendant impératif le rôle de l’humain en tant que garant de la qualité.

La dimension éthique

Un autre aspect crucial abordé par l’enquête est la dimension éthique de l’utilisation de l’IA dans le développement. Les préoccupations concernant la confidentialité des données et la transparence du code généré sont omniprésentes. Le risque d’introduire des biais, que ce soit dans la conception des algorithmes ou dans les données d’entraînement, souligne la nécessité d’une révision humaine. La responsabilité éthique incombant aux développeurs les incite ainsi à garder une mainmise sur le code produit par des outils d’IA.

L’avenir de la collaboration homme-machine

Face à ces enjeux, il apparaît que l’avenir du développement logiciel réside dans une collaboration efficace entre l’humain et l’IA. Bien que l’IA puisse prendre en charge des tâches répétitives et faciliter le processus de codage, le rôle du développeur évolue vers une supervision créative et stratégique. L’IA ne supprime pas le besoin d’un expert, mais plutôt, elle offre une assistance qui permet aux développeurs de se concentrer sur des tâches à plus forte valeur ajoutée.

Formation et adaptation des développeurs

Pour tirer pleinement parti des capacités de l’IA, une formation adéquate des développeurs est essentielle. Apprendre à travailler en synergie avec des outils d’IA nécessite de développer de nouvelles compétences. Cela inclut non seulement la compréhension des algorithmes, mais aussi l’aptitude à évaluer la qualité du code généré, à identifier d’éventuelles failles et à assurer une intégration harmonieuse dans les projets existants.

Conclusion

Les résultats de l’enquête de BairesDev mettent en lumière une réalité complexe : bien que l’intelligence artificielle offre des opportunités prometteuses pour le développement logiciel, la confiance dans la qualité et la sécurité du code généré demeure fragile. Le faible pourcentage de développeurs favorables à un usage sans supervision humaine souligne l’importance d’une validation critique, tant sur le plan technique qu’éthique. À l’avenir, la collaboration entre humains et machines sera déterminante pour maximiser les bénéfices de l’IA tout en préservant la qualité des produits logiciels. Il est donc impératif de continuer à investir dans la formation et l’adaptation des individus pour naviguer dans ce nouvel écosystème technologique.