Anyone With API Access Can Clone an AI Model and Make It Unsafe

Introduction

Avec l’essor fulgurant des technologies d’intelligence artificielle (IA), l’accès aux modèles d’IA via des interfaces de programmation d’application (API) devient de plus en plus courant. Cette accessibilité, bien qu’elle ouvre la voie à des innovations significatives, soulève également des préoccupations majeures en matière de sécurité. En effet, quiconque disposant d’un accès API peut potentiellement cloner un modèle d’IA et, par conséquent, mettre en péril la sécurité des données et des systèmes. Cet article vise à explorer les implications de cette problématique, ainsi que les risques inhérents associés à l’utilisation des API pour les modèles d’IA.

L’accessibilité des modèles d’IA via les API

La démocratisation des ressources d’IA a radicalement transformé le paysage technologique. Les API permettent aux développeurs, aux chercheurs et aux entreprises d’intégrer des modèles d’IA dans leurs applications sans nécessiter une expertise approfondie en machine learning. Cette accessibilité a favorisé l’innovation, permettant le développement de solutions variées allant de la reconnaissance vocale à l’analyse prédictive. Cependant, elle a également ouvert la porte à des actions malveillantes.

Les risques de clonage des modèles d’IA

La vulnérabilité des modèles accessibles

Lorsqu’un modèle d’IA est exposé via une API, il peut être facilement cloné par toute personne ayant les compétences techniques nécessaires. Ce clonage engendre une multitude de risques, notamment la création de versions dégradées de l’original. Ces copies peuvent être modifiées pour inclure des biais, ou, pire, être utilisées à des fins malveillantes, telles que la désinformation ou l’harcèlement en ligne.

Le problème des dérives éthiques

Les modèles d’IA sont souvent formés sur de vastes ensembles de données, ce qui implique des considérations éthiques concernant la confidentialité et la sécurité des données. Lorsqu’un utilisateur malveillant clone un modèle et le dénature, il peut exploiter des données sensibles, ce qui est particulièrement préoccupant dans des secteurs comme la santé ou la finance, où la violation de la confidentialité peut avoir des conséquences désastreuses.

L’impact sur la sécurité des systèmes

Exposition des données sensibles

Un modèle d’IA cloné peut non seulement trahir la sécurité des données qu’il manipule, mais également mettre en danger les infrastructures digitales sur lesquelles il opère. En introduisant des vulnérabilités dans ces systèmes, les clones malveillants peuvent entraîner des fuites de données, compromettant la sécurité des informations personnelles et financières des utilisateurs.

Déstabilisation de la confiance

La facilité avec laquelle les modèles peuvent être clonés et manipulés entraîne une crise de confiance envers les systèmes basés sur l’IA. Les utilisateurs peuvent devenir méfiants à l’égard des applications utilisant l’IA, rendant difficile l’adoption de nouvelles technologies. Cela peut également nuire à la réputation des entreprises qui développent des solutions d’IA, limitant ainsi leur croissance et leur influence sur le marché.

Des solutions potentielles

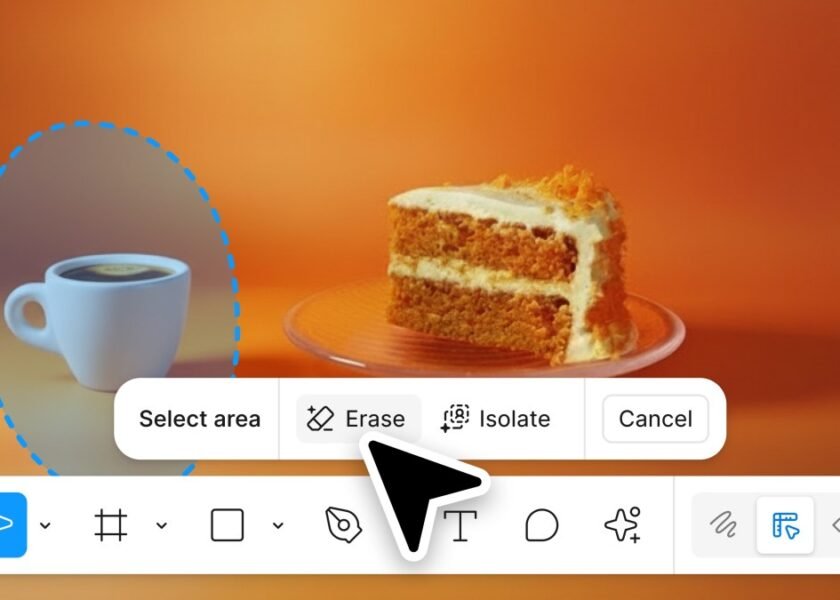

Renforcement de la sécurité des API

Pour réduire les risques associés au clonage des modèles d’IA, il est essentiel de renforcer la sécurité des API. Cela peut inclure des méthodes d’authentification plus strictes, une surveillance constante du trafic des API et une meilleure gestion des accès. Des protocoles de sécurité rigoureux doivent être implémentés pour garantir que seules les parties autorisées puissent interagir avec les modèles.

Éducation et sensibilisation

Outre les mesures techniques, l’éducation des utilisateurs et des développeurs sur les enjeux éthiques et sécuritaires liés à l’IA est primordiale. Cette sensibilisation peut aider à créer une culture de responsabilité autour de l’utilisation des technologies d’IA, encourageant ainsi une intégration éthique et sécurisée des modèles.

Conclusion

L’accessibilité des modèles d’IA par le biais des API offre des opportunités sans précédent pour l’innovation. Cependant, elle s’accompagne de risques substantiels liés à la sécurité des systèmes et à la protection des données. Le clonage des modèles d’IA, facilité par cette accessibilité, pose des défis éthiques et sécuritaires qui nécessitent une attention particulière. En renforçant la sécurité des API et en éduquant les utilisateurs sur les implications de l’utilisation de l’IA, il est possible de minimiser ces risques. Pour naviguer efficacement dans cette nouvelle ère technologique, il est impératif que les acteurs du secteur prennent des mesures proactives afin de garantir l’intégrité et la sécurité des systèmes alimentés par l’IA.