10 Must-Know Questions About Large Language Models and Attention Mechanisms | by Manash Pratim

10 Questions Essentielles à Connaître sur les Modèles de Langage de Grande Taille et les Mécanismes d’Attention

Introduction

Les modèles de langage de grande taille (MLGT) ont révolutionné le domaine du traitement du langage naturel (NLP) en améliorant les performances des applications allant de la traduction automatique à la génération de texte. Au cœur de ces progrès se trouvent les mécanismes d’attention, qui permettent aux modèles de se concentrer sur des parties spécifiques des données d’entrée pour produire des sorties plus pertinentes. Cet article explore dix questions clés pour mieux comprendre les MLGT et les mécanismes d’attention, en offrant un aperçu à la fois théorique et pratique.

Qu’est-ce qu’un Modèle de Langage de Grande Taille ?

Un modèle de langage de grande taille est un type de modèle d’apprentissage automatique entraîné sur d’énormes quantités de données textuelles. Ces modèles utilisent des architectures profondes, souvent basées sur des réseaux neuronaux transformateurs, pour prédire la probabilité d’apparition d’une séquence de mots. L’énormité de leur taille, souvent mesurée en paramètres, est un facteur déterminant de leur capacité à saisir des nuances complexes du langage naturel.

Pourquoi les Mécanismes d’Attention sont-ils Cruciaux ?

Les mécanismes d’attention permettent aux modèles de pondérer l’importance relative de chaque mot dans une séquence donnée. En utilisant des coefficients d’attention, qui indiquent l’importance d’un mot par rapport aux autres, les modèles peuvent mieux gérer les relations à long terme dans le texte. Cela améliore la pertinence des réponses générées et rend les modèles beaucoup plus efficaces pour des tâches variées.

Comment Fonctionnent les Mécanismes d’Attention ?

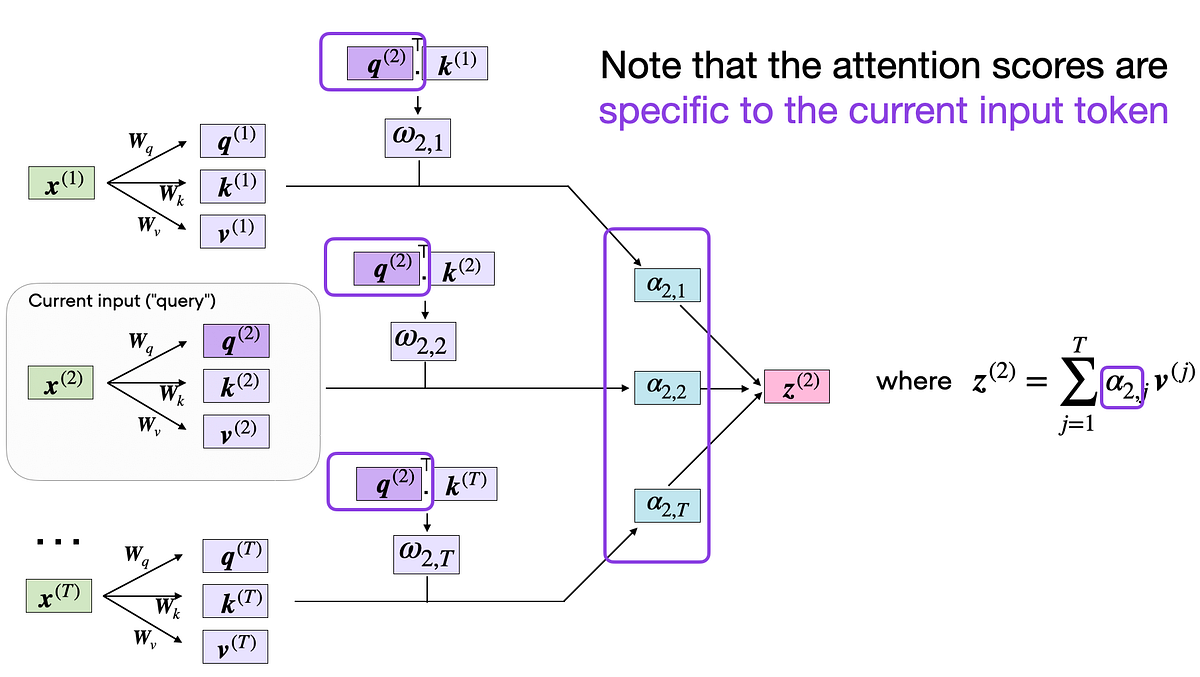

Les mécanismes d’attention fonctionnent notamment par l’application de trois vecteurs : le vecteur de requête (query), le vecteur de clé (key) et le vecteur de valeur (value). Chaque mot de la séquence est associé à ces vecteurs, qui sont utilisés pour calculer une attention pondérée. Ce processus permet au modèle de "se concentrer" sur les mots les plus importants pour la tâche à accomplir, en attribuant des poids qui influencent les sorties.

Quelle est la Différence entre Attention et Auto-Attention ?

L’attention peut être générale ou locale, but l’auto-attention est spécifiquement un mécanisme qui permet à chaque position d’une séquence d’interagir avec toutes les autres. Cela signifie que chaque mot peut influencer tous les autres mots du texte, facilitant la capture de dépendances contextuelles complexes. Cette approche est particulièrement efficace dans les modèles générés par des transformateurs.

Quelle Rôle Jouent les Couches de Mécanismes d’Attention dans les Transformeurs ?

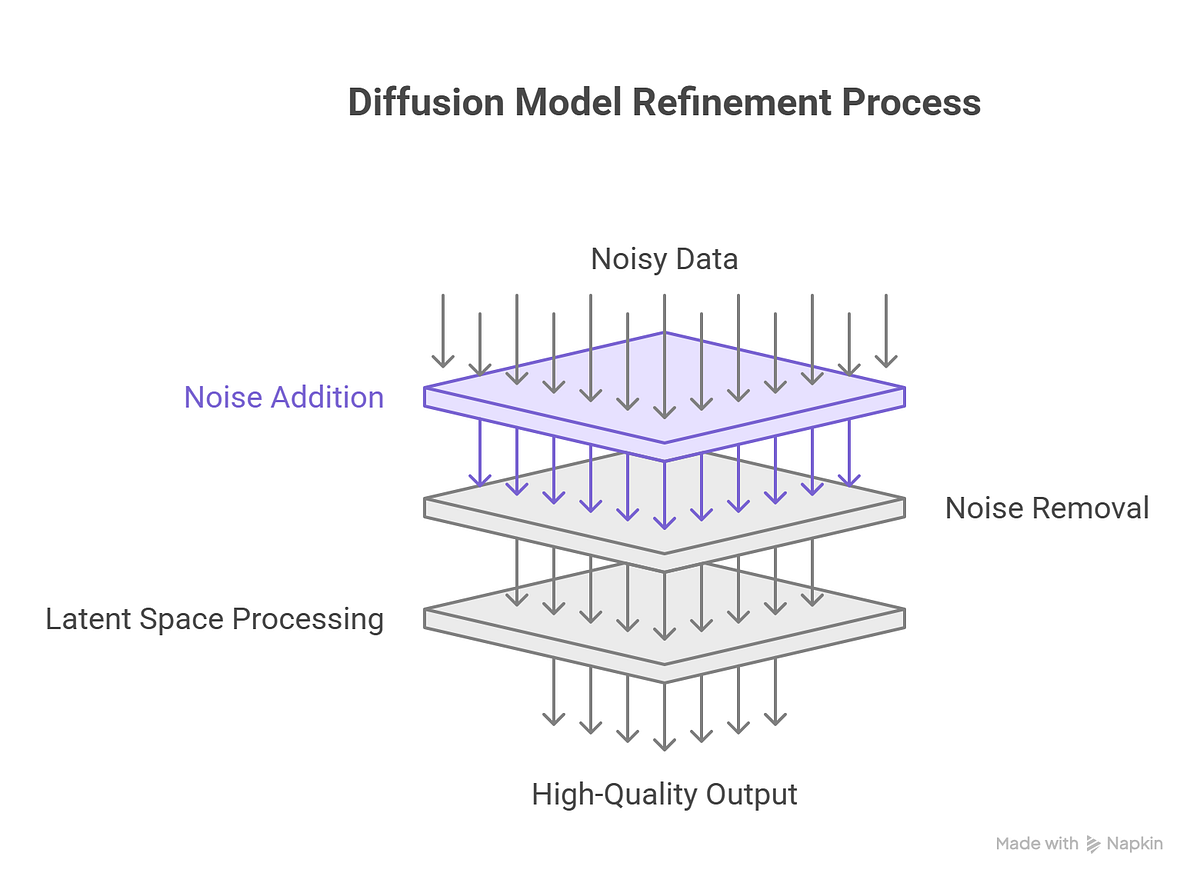

Dans les architectures basées sur les transformeurs, les couches de mécanismes d’attention sont intégrées à plusieurs niveaux. Chaque couche apprend des représentations de plus en plus abstraites, permettant au modèle de capturer différentes facettes du langage. Les couches d’attention multi-têtes, par exemple, permettent de traiter plusieurs relations en parallèle, augmentant ainsi la richesse des représentations.

Quels Sont les Défis Associés aux Modèles de Langage de Grande Taille ?

Malgré leurs performances impressionnantes, les MLGT font face à plusieurs défis, y compris la consommation élevée de ressources computationnelles, le risque de biais dans les données et les questions éthiques concernant l’utilisation de ces modèles. En outre, leur taille peut rendre leur déploiement dans des environnements à ressources limitées problématique.

Comment Évaluer l’Efficacité d’un Modèle de Langage ?

L’évaluation des modèles de langage se fait généralement à l’aide de métriques standardisées comme la perplexité, la précision ou le F1-score. D’autres approches impliquent des évaluations qualitatives, notamment des tests de qualité de génération de texte, pour vérifier la cohérence et la pertinence des sorties.

Quelles Sont les Applications Pratiques des Modèles de Langage de Grande Taille ?

Les applications des MLGT sont variées, allant des chatbots aux systèmes de recommandation, en passant par la rédaction assistée. Leur capacité à comprendre et générer du langage naturel a transformé la manière dont les entreprises interagissent avec les clients et améliorent l’expérience utilisateur.

Quelles Sont les Perspectives d’Avenir pour les Modèles de Langage ?

L’avenir des modèles de langage de grande taille semble prometteur, avec des recherches continues visant à améliorer leur efficacité et à réduire leur empreinte carbonique. Les innovations pourraient inclure des techniques d’apprentissage fédéré, permettant une collaboration sécurisée entre différents modèles sans nécessiter de centralisation des données.

Conclusion

Les modèles de langage de grande taille, associés aux mécanismes d’attention, constituent une avancée majeure dans le traitement des langues naturelles. Leur capacité à traiter des informations complexes de manière efficace ouvre des perspectives prometteuses tant sur le plan commercial que technologique. En répondant aux questions essentielles posées dans cet article, les chercheurs et praticiens du domaine peuvent mieux naviguer dans ce paysage en constante évolution, tout en tenant compte des défis éthiques et pratiques qui se présentent.