GenAI Data Poisoning: How 100 Samples Can Corrupt a Multi-Billion Parameter AI

GenAI Data Poisoning : Comment 100 Échantillons Peuvent Corrompre une IA à Multi-Milliards de Paramètres

Introduction

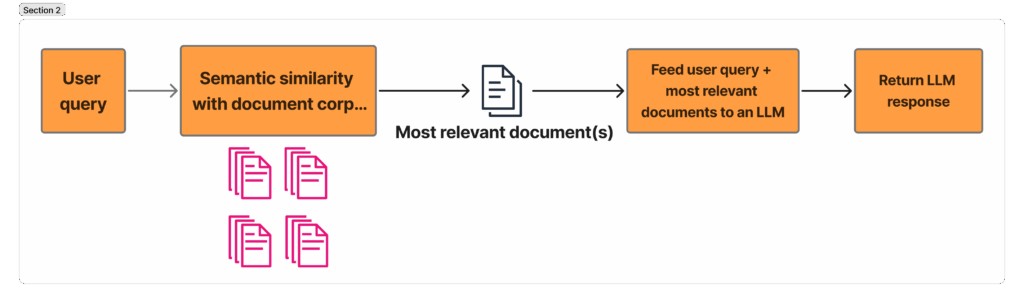

L’essor des intelligences artificielles génératives (GenAI) a révolutionné de nombreux secteurs, des arts à la recherche scientifique en passant par le service client. Cependant, cette avancée technologique s’accompagne de nouvelles vulnérabilités, dont la plus préoccupante est le data poisoning. Cette technique malveillante permet à des attaquants d’influencer le comportement d’un modèle d’intelligence artificielle en introduisant des données erronées durant la phase d’apprentissage. Cet article explore comment une poignée d’échantillons, aussi peu que 100, peut suffire à compromettre l’intégrité d’un modèle d’IA comptant des milliards de paramètres.

Compréhension du Data Poisoning

Définition et Mécanismes

Le data poisoning consiste à altérer un ensemble de données d’entraînement afin de fausser les résultats d’un modèle d’intelligence artificielle. Les attaquants peuvent injecter des informations biaisées, erronées ou malveillantes dans l’ensemble de travail, ce qui conduit à des décisions erronées par le modèle. Ce phénomène peut être particulièrement dévastateur pour des modèles de grande envergure, qui sont souvent intégrés dans des systèmes critiques tels que la santé ou la finance.

Typologies de Data Poisoning

Il existe plusieurs types de data poisoning, allant des attaques par empoisonnement de labels, où les étiquettes des données sont modifiées, aux attaques par empoisonnement d’entrées, qui introduisent des exemples délibérément malformés. Chaque méthode vise à déstabiliser le modèle, rendant difficile son apprentissage des patterns existants dans les données.

Impact d’un Échantillonnage Minime

La Force de l’Échantillonnage Limitée

Tout échantillon biaisé a le potentiel d’influer sur le modèle. En pratique, une attaque ciblée avec à peine 100 échantillons malveillants peut suffire à changer significativement les résultats d’un modèle. En effet, même un modèle à multi-milliards de paramètres peut être affecté par un ensemble d’apprentissage soigneusement sélectionné qui crée des divergences dans les prévisions futures.

Exemples Concrets

Des études de cas ont illustré l’impact du data poisoning. Par exemple, une recherche a montré que l’injection de données faussement étiquetées dans des modèles de classification d’images entraînés sur des millions d’échantillons a conduit à des taux de classification erronés pouvant atteindre 40 %. Cela soulève des questions essentielles concernant la robustesse de ces modèles face à des attaques ciblées.

Stratégies de Mitigation

Renforcement des Protocoles de Sécurisation

Pour contrer le data poisoning, il est impératif de mettre en place des protocoles de sécurisation robustes. Cela peut inclure l’utilisation de méthodes d’évaluation des données avant leur intégration dans le modèle, ainsi que des algorithmes capables de détecter des anomalies dans les ensembles de données.

Approches par Évaluation de la Fiabilité des Données

Une autre stratégie consiste à intégrer des scores de fiabilité pour chaque échantillon de données. En évaluant la provenance et l’historique des données, un modèle peut apprendre à ignorer ou à les traiter avec précaution, réduisant ainsi l’influence de données potentiellement corrompues.

Conclusion

Le data poisoning représente une menace sérieuse pour les intelligences artificielles génératives, surtout pour les modèles de grande échelle comptant des milliards de paramètres. En ne tenant compte que d’une centaine d’échantillons malveillants, des acteurs malintentionnés peuvent modifier radicalement les résultats prédictifs de ces systèmes. Il est essentiel d’adopter des mesures de sécurité rigoureuses et innovantes pour protéger les modèles d’IA et assurer leur fiabilité. À mesure que l’utilisation des IA se généralise, la vigilance face à ce type de cybermenace est plus cruciale que jamais pour préserver l’intégrité et la performance de ces technologies prometteuses.