Deep Learning Part — 8: Optimizing Neural Networks’ Learning through Initialization & Normalization | by Chandra Prakash Bathula | Oct, 2025

Optimiser l’apprentissage des réseaux de neurones grâce à l’initialisation et à la normalisation

Introduction

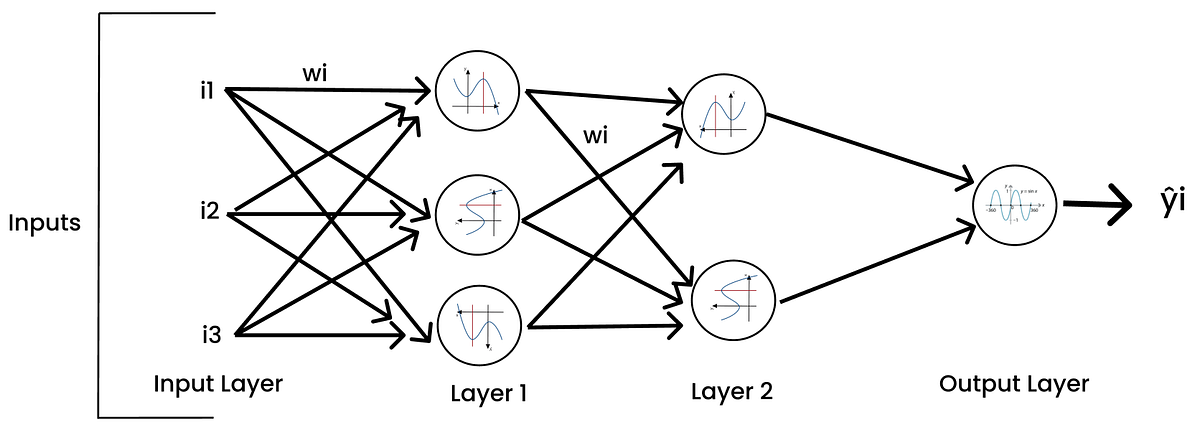

Dans le domaine du deep learning, l’efficacité des réseaux de neurones repose sur des choix méthodologiques critiques, notamment en ce qui concerne l’initialisation des poids et la normalisation des données. Ces deux aspects jouent un rôle fondamental dans la convergence des modèles et, par conséquent, dans leur performance globale. Cet article examine comment une bonne initialisation et des techniques de normalisation peuvent transformer la façon dont les réseaux de neurones apprennent, renforçant ainsi leur capacité à résoudre des problèmes complexes.

L’importance de l’initialisation des poids

L’initialisation des poids est l’un des aspects les plus cruciaux lors de la construction d’un réseau de neurones. Une initialisation inadéquate peut mener à des problèmes tels que les gradients évanescents ou explosifs, rendant l’apprentissage difficile, voire impossible. L’initialisation aléatoire est souvent utilisée, mais des techniques telles que l’initialisation de Xavier et l’initialisation de He ont été développées pour mieux adapter la répartition des poids à la fonction d’activation utilisée.

Initialisation de Xavier

L’initialisation de Xavier, également connue sous le nom d’initialisation de Glorot, est adaptée pour les fonctions d’activation comme la tangente hyperbolique. Elle consiste à tirer les poids à partir d’une distribution uniforme ou normale dont la variance est proportionnelle à la moyenne des neurones de l’entrée et de la sortie. Ce choix permet de maintenir la variance des activations à travers les couches, facilitant ainsi une meilleure propagation du gradient.

Initialisation de He

Pour les réseaux utilisant des fonctions d’activation ReLU (Rectified Linear Unit), l’initialisation de He est recommandée. Cette méthode ajuste la variance de manière à compenser le fait que la fonction ReLU coupe la moitié des valeurs. Comme l’initialisation de Xavier, elle contribue à éviter les problèmes de gradient et permet une convergence plus rapide.

Techniques de normalisation

Une autre composante essentielle de l’optimisation des réseaux de neurones est la normalisation des données. Les techniques de normalisation ajustent les entrées pour qu’elles aient une moyenne nulle et une variance unitaire. Cela aide non seulement à stabiliser l’apprentissage, mais aussi à accélérer la convergence.

Normalisation par lot (Batch Normalization)

La normalisation par lot est l’une des approches les plus populaires. Elle normalise les activations au sein d’un lot, permettant ainsi de réduire la covariate shift, un phénomène qui se produit lorsque la distribution des entrées d’un modèle change pendant l’apprentissage. En normalisant les activations, la Batch Normalization permet d’accélérer l’apprentissage et d’atténuer le surajustement grâce à une régularisation implicite.

Normalisation Layer-wise

La normalisation par couche, ou Layer Normalization, est utilisée souvent dans des architectures spécifiques comme les modèles de traitement du langage naturel. Contrairement à la Batch Normalization, elle normalise les activations sur chaque exemple. Cela permet une plus grande stabilité dans les cas où la taille du lot est petite ou lorsque les données sont très variées.

Interactions entre initialisation et normalisation

L’initialisation des poids et la normalisation sont intimement liées. Une bonne initialisation peut rendre l’effet des méthodes de normalisation encore plus significatif. En effet, une initialisation soigneusement choisie peut transformer les activations des couches, rendant les normalisations par lot ou par couche plus efficaces. Inversement, des techniques de normalisation peuvent également minimiser l’impact d’une initialisation incorrecte.

Conclusion

L’initialisation et la normalisation sont deux piliers fondamentaux de la formation réussie des réseaux de neurones. Une initialisation appropriée permet d’éviter les problèmes de gradient, tandis que des techniques de normalisation assurent la stabilité et l’efficacité de l’apprentissage. En intégrant ces deux stratégies, les chercheurs et les praticiens peuvent améliorer considérablement les performances des modèles de deep learning. À l’ère des applications de l’intelligence artificielle, une compréhension profonde de ces concepts est impérative pour innover et concevoir des systèmes toujours plus performants. La combinaison d’une initialisation réfléchie et d’une normalisation efficace constitue, sans aucun doute, la clé d’un apprentissage réussi des réseaux de neurones.